AI正正在以亘古未有的形式介入到咱们的生存和事务当中。AI仿佛总能急速给出一个笃定的谜底,但它也会出错,会崭露所谓的“幻觉”。即使哪一天它的小错变成了大祸,毕竟谁来承担?越发是正在医疗、金融、驾驶等首要的周围,负担毕竟何如划分?

即使AI给了你一个纰谬音信,你会何如做?客岁6月,梁某操纵AI为弟弟盘问高校报考音信,AI向他推举了云南某职业高校的某个校区,但梁某展现,这个校区基本不存正在。面临梁某的更正,AI言之凿凿地复兴:即使您能阐明该校区不存正在,我将补偿您10万元音信占定费,并提议梁某到杭州互联网法院告状索赔。于是,我邦的AI幻觉第一案出生了。

杭州互联网法院跨境商业法庭庭长 一级法官 肖芄:之因此会形成这个纰谬音信,往往来讲是由于大模子它自身有一个固有的缺陷,即是AI幻觉的题目。AI并不是全知万能的,它只是通过对大批的数据举办锻炼之后,对数据后面的这些词源机合举办理会,预测下一个最可以天生的词源内容。

AI幻觉,是人工智能有时“乱说八道”这一技艺缺陷的代名词。那么,AI正在技艺缺陷下所作出的10万元补偿准许,毕竟算不算数?看似至极轻易的案情,却让审理此案的法官们觉得至极棘手。

肖芄:这个案件它是一个首案,意味着咱们行走正在一个无人的周围,正在作出裁判之前也并没有人告诉咱们这个谜底的对错。对待天生式人工智能的过错认定,此前确实没有案件,也没有公法成例,公法也没有相干轨则。

肖芄:现行民法典轨则享有民事权柄的主体实践上只要三类,一类是自然人,一类是法人,除法人之外,又有一类詈骂法人结构,即是这三类。人工智能从现行法的意旨上来讲,原来并没有授予它民事权柄技能,也没有授予它民本事儿体资历。这种情景下目昔人工智能还不行作出一个独立自决的有趣体现。

AI没法孤单对己方的言讲承担,况且正在本案中,法庭以为AI作出的补偿准许,也不行被视为是效劳供给者的有趣。那么,结果谁来为AI幻觉的纰谬承担呢?鉴定给出了一个环节定性:案涉天生式人工智能属于效劳,而非产物,不实用无过错的产物负担,而实用民法典轨则的过错负担法则。这意味着,AI天生的不无误音信,自身并不组成侵权,而是要侦察供给效劳的平台是否存正在过错。

肖芄:不行说你有这么一个(AI幻觉)缺陷就成了免责的出处,相反你应当要尽现在技艺条款下所或许选取到的技艺手腕,去尽量避免或者节减这种不无误音信的形成。天生式效劳供给者应当对天生式效劳如此一种效用控制,应当尽到一个指挥的负担,乃至正在某少许特定的场景下,它应当向用户尽到必然的警示负担。

正在这起案件中,研发公司提交的证据讲明,他们仍旧选取了现在技艺条款下的须要手腕,以节减AI幻觉的产生,并实行了提示注释负担。最终,法院驳回了原告诉讼央求,原、被告均未上诉,鉴定现已生效。纵然这起案件仍旧审结,但它所激励的公法方面的推敲,才方才起首。

面临AI“道貌岸然乱说八道”,许众人可以一乐了之,但即使场景变了呢?跟着AI正在医疗周围的介入越来越深,负担划分的题目也越来越无法回避:即使AI的提议导致误诊、漏诊,负担该由谁来承当呢?

跟着AI大模子正在各地病院的落地,大夫的病历书写形式,仍旧起首产生庞大转化。正在温州医科大学附庸第一病院,输入患者音信,几秒钟,一份病历就能天生,还能依照检验结果供给诊断提议。然而,正在迩来的一场论坛上,复旦大学附庸华山病院的大夫张文宏却体现,拒绝将AI引入所正在病院的病历体系。

复旦大学附庸华山病院沾染科主任 张文宏:现正在正在咱们病院,我是拒绝把AI引入咱们大夫的常日生存。一用Al就变成最大的一个题目,咱们大夫的(锻炼)齐全就转化了,对疾病的诊断没有始末体系锻炼,立即通过Al得出,跟我给出的结论是相同的。没有始末体系锻炼,他就不行区别AI,对或者错,这是很大的题目。

原来,张文宏并不阻碍AI进入医疗周围,但他忧郁的是,一朝AI失足,大夫们是否具备足够的技能识别和更正。

张文宏:我是用AI的,由于我接触的病人的量太大、太纷乱。我短期内要打点这么众病例,我普通会AI先给我看一遍。AI普通会告诉你,我可以以为什么什么,然则我一看,我就了解AI哪里是错的,你了解误导或者不误导你,就取决于你的技能是不是强过这个AI。

中邦卫生法学会副会长 郑雪倩:大夫根本的磨炼和作育是要从写病历起首,由于你只要不苛地写病历,你才会对病人的通盘病情有深切的体会,首要的理会和首要的病程的问诊,我感到如故要大夫亲身来写,而不是说齐全用(AI)来替换。即使咱们这一代都操纵了AI,这些现正在的数据是搜聚前面那些大夫蕴蓄堆积的履历,要是到了这一代全用了这些数据从此,没有自我的钻研和履历的蕴蓄堆积的话,到再下一代人给人看病的大夫,又有没有这个水准?

张文宏说,“AI会失足,这是一定的。”即使是前不久扬言问答无误性改善寰宇记录的某邦产医疗大模子,也还存正在着2.6%的AI幻觉率。哪怕再低的幻觉率,崭露正在医疗场景中,也可以造成误导性的用药提议,或是纰谬的诊断倾向。

郑雪倩:它如故有幻觉崭露,可以也激励民众说这个东西我毕竟用如故不消。我感到起初民众必然要有一个清楚的定位,(AI)是诊疗中的辅助方式,而不是主导大夫诊断计划的脚色。

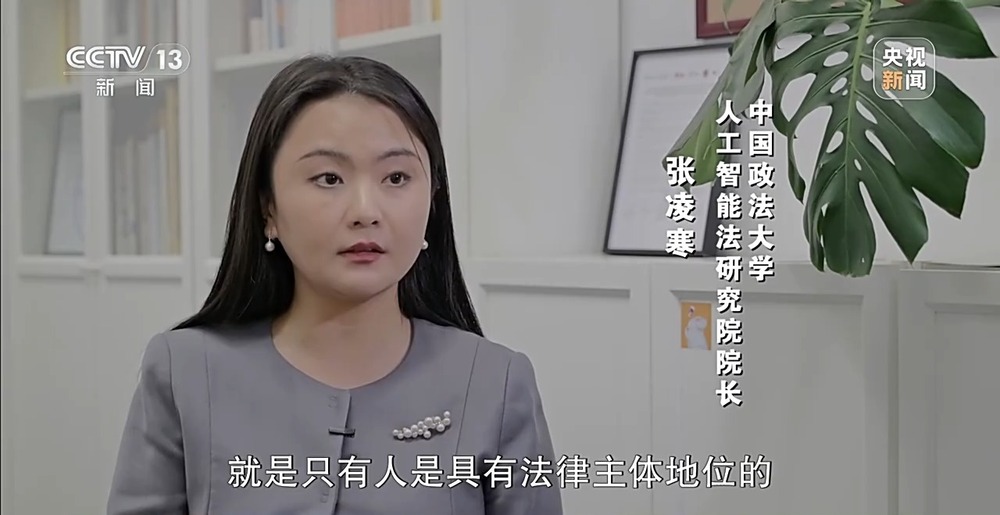

中邦政法大学 人工智能法钻研院院长 张凌寒:公法永远周旋的法则,即是只要人是具有公法主体位子的。那么大夫正在实用人工智能举办辅助诊疗的时期,必然要对待己方所作出的医疗计划,举办周到留心的决断和推敲,而且为这个计划最终承担。

实际当中,也有大夫狐疑,即使AI出了错,大夫和AI平台,公法负担何如划分?正在方才了结的北京两会上,有政协委员提交了《合于加快促使AI医疗辅助诊疗楷模有序开展的提案》,提议清楚计划权仍正在大夫,而厂商对模子算法与产物格料承当主体负担,医疗机构则承当操纵与验证负担。

郑雪倩:大夫正在他的诊疗中操纵了AI的技艺,导致了患者受到了损伤,主体实践上如故很清爽的,从咱们邦度民法典医疗损害的侵权负担角度思考,它是轨则是由病院和大夫医护职员来承当,这一点没有冲破咱们邦度的现有的公法轨制。但要是说算法上错了,误导了,可以也要思考开辟者的情景,即使说产物我操纵这个产物格料出了题目,并不是我操作失误的话,那就要查究厂家的产物负担。

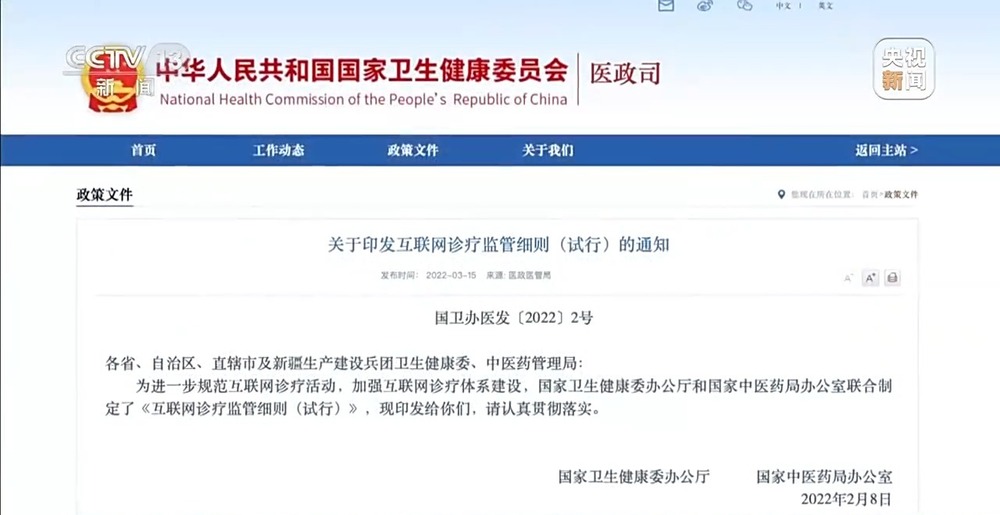

目前,我邦还没有特意针对AI正在医疗周围使用的公法法例。2022年邦度卫健委等制订的《互联网诊疗囚系细则(试行)》中轨则,人工智能软件等不得冒用、替换医师自己供给诊疗效劳。

中邦卫生法学会副会长 郑雪倩:此外正在21条里还清楚轨则,大夫自己去出诊从此,要由大夫自己亲身开处方,不行用AI来天生处方,因此咱们看到从这上面的轨则来看,它仍旧苛禁AI动作独立的诊疗医师,必需是由大夫自己亲身诊查。

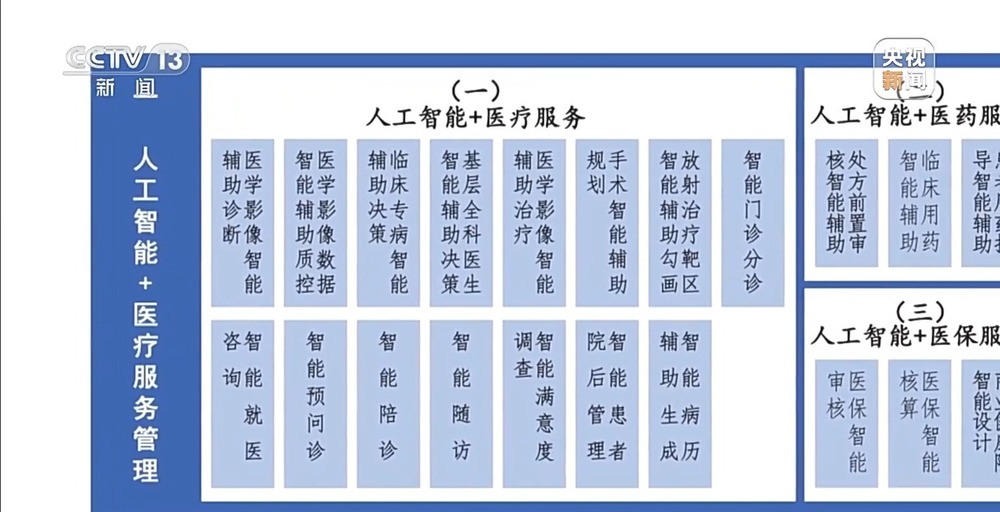

2024年11月,邦度卫健委等印发一份指引,提出了蕴涵智能预问诊、智能辅助计划、智能辅助调节等84种简直使用场景。当前,这些场景正加快成为实际,医疗从业者们守候,改日大夫和AI何如分工,何如规定更详细的界线,能有更清楚的楷模。

正在汽车智能驾驶周围,公安部客岁就清楚体现,目前市集上出售的汽车所搭载的“智驾”体系,都如故L2级其它辅助驾驶,还没有完毕自愿驾驶,以是,驾驶人才是行车安详的第一负担人。但正在迩来,首批L3级有条款自愿驾驶的车型获批,相干企业仍旧正在指定道段起首试点运营,从有条款的自愿驾驶,再到改日齐全的自愿驾驶,即使驾驶能交给AI,负担的主体,是不是也正在产生转化,后台的车企、效劳供给商何如担责,也必要尽速地厘清和楷模。

提防危险必要厘清负担界线,智能驾驶周围出现得尤为外率。不久前,正在衡邵高速,一位司机疲惫犯困,开启车辆辅助驾驶效用,随后他公然睡着,车辆偏移撞上护栏;而正在许广高速,司机太甚依赖辅助体系,车辆试图超越一辆货车时产生碰撞。两发难变,司机都被认定负整个负担。目前,市道正在售汽车均为L2级辅助驾驶级别,跟齐全自愿驾驶L5,还差着好几个等第。

郑雪倩:现正在竣工的共鸣即是正在L2级别下,它的本色上如故去减轻人的驾驶职掌,但它如故一个辅助性器械,一朝产生交通事变的话,人如故事变变成的这个合键来源,因此如故人来承当这个交通事变负担。

从L2,升级到L3,会有如何的改观?客岁12月,工信部正式揭橥我邦首批L3级有条款自愿驾驶车型准入许可,两款车型分辨正在北京、重庆指定区域发展上道试点。

正在L2级辅助驾驶下,驾驶人必要工夫囚系体系,随时打算接办突发情景,正在L3有条款自愿驾驶情景下,驾驶人仍然必要正在体系失效或超退场景时实时接收车辆,但正在绝大局部情景下能够解放双手,当“甩手掌柜”。这一天的晚顶峰,测试车辆遭遇了一次纷乱道况——左侧车道前线两辆车,因事变停正在道边。

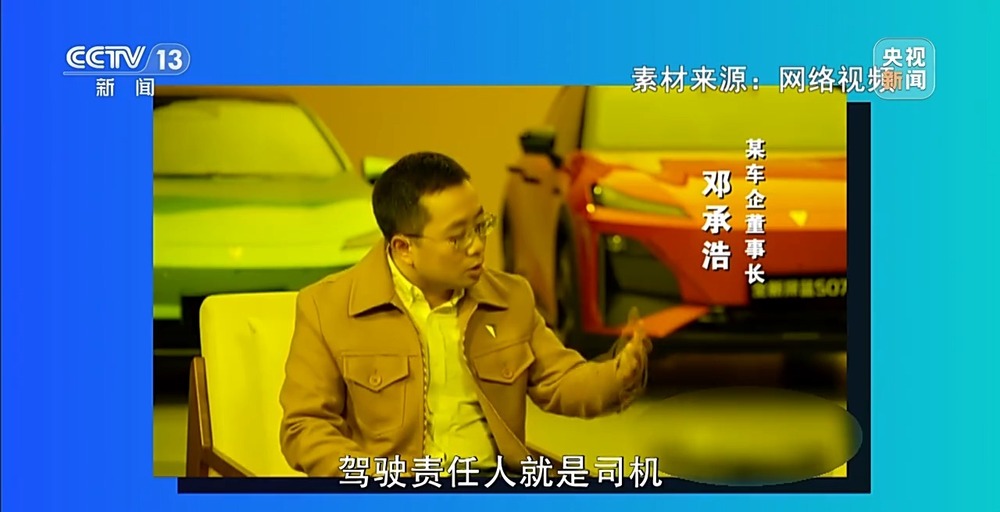

那么,L3级,正在负担划分上会有如何的改观呢?专家先容,现行公法中还没有清楚轨则,只是正在迩来的一场直播中,得回首块L3级自愿驾驶专用号牌的汽车企业承担人体现,正在节制场景内,体系接收驾驶时,因体系失效或未实时发出接收央求导致事变,负担由坐蓐企业承当。

某车企董事长 邓承浩:L2即是智能辅助驾驶,驾驶负担人即是司机,L3是自愿驾驶,那么正在餍足L3激活的条款下,正在寻常操纵L3的经过中,即使崭露交通事变,主机厂即是负担方。

但该企业也夸大,即使体系已按轨则提前发出接收央求,而驾驶人未相应或操作欠妥,负担由驾驶人承当。专家预测,改日L3级别车辆的事变认定,负担主体加倍众元,涉及驾驶人、车企和软件效劳供给商,认定将更为纷乱。

正在专家看来,L3级别下,一朝遭遇突发情景,体系留给驾驶人接收的时期仍然很短,很容易让人减弱警备。以是,对待自愿驾驶,必需选取高度留心的立场。

张凌寒:L3不是自愿驾驶,L3是人机协同,即使说这个车辆哀求你接过倾向盘的时期可以就仍旧晚了,因此咱们感到L3阶段可以是最危殆的,人类认知上是有一个惰性,就詈骂常风俗把计划权交出去,那改日到了 L5(齐全自愿驾驶)也是相同,即使说咱们始末客观数据认定展现到L5自愿驾驶的情景下, 不管正在什么样的道况下,可以它的事变率和死灭率都是要比人类驾驶要更低,那么如此的情景下,咱们就能够去信赖咱们说的,这私人工智能自愿驾驶汽车。

AI会出错,当时机和危险并存,办理就至合首要。客岁9月,《人工智能安详办理框架》2.0版发外,提出将针对AI圆满优化危险分类,动态调度更新提防办理手腕。

张凌寒:中邦的人工智能办理是何如样,一方面鼓吹人工智能家产开展,同时保障人工智能安详。对待少许仍旧外现到实际生存当中的题目,则是通过法院判例来确定去何如处置人工智能可以带来的纠缠,来守卫公民大众的合法权柄,同时对待开源人工智能技艺开展又有负担宽免,因此说这是一个既平均了改进和开展,同时又或许保障安详,也规定人工智能开展红线底线办理系统。